嗯,用户让我帮忙总结一下这篇文章的内容,控制在100个字以内。首先,我需要通读整篇文章,抓住主要信息。 文章主要介绍了一个叫做llmfit的工具,它是一个TUI程序,可以在终端上运行。这个工具的作用是帮助用户检测他们的电脑硬件配置,然后从500多个大模型中筛选出适合运行的模型。运行后会显示模型评分、推理速度、内存占用等信息,让用户一目了然。 接着,文章还提到了使用llmfit的一些技巧,比如如何筛选模型提供商和快速找到特定模型。然后讨论了本地模型的优势,包括隐私保护、成本节省以及无需联网等。最后,文章还提到了如何部署本地模型,推荐了一些工具如Ollama和LM Studio。 现在我需要把这些信息浓缩到100个字以内。重点应该放在llmfit的功能、优势以及本地部署的好处上。同时要保持语言简洁明了。 可能的结构是:先介绍llmfit是什么及其功能,然后提到本地模型的优势和部署方法。这样既全面又简洁。 最后检查一下字数是否在限制内,并确保没有使用“文章内容总结”之类的开头。 </think> llmfit 是一款 TUI 工具,可快速检测电脑硬件并从 500+ 大模型中筛选适合运行的模型。支持隐私保护、离线运行及低成本部署本地模型。 2026-3-8 10:50:48 Author: www.appinn.com(查看原文) 阅读量:27 收藏

终于有这样的工具了,帮你从 500 多款大模型中,1秒测出:你的电脑能跑哪些 AI 大模型。

目录

llmfit 是什么?

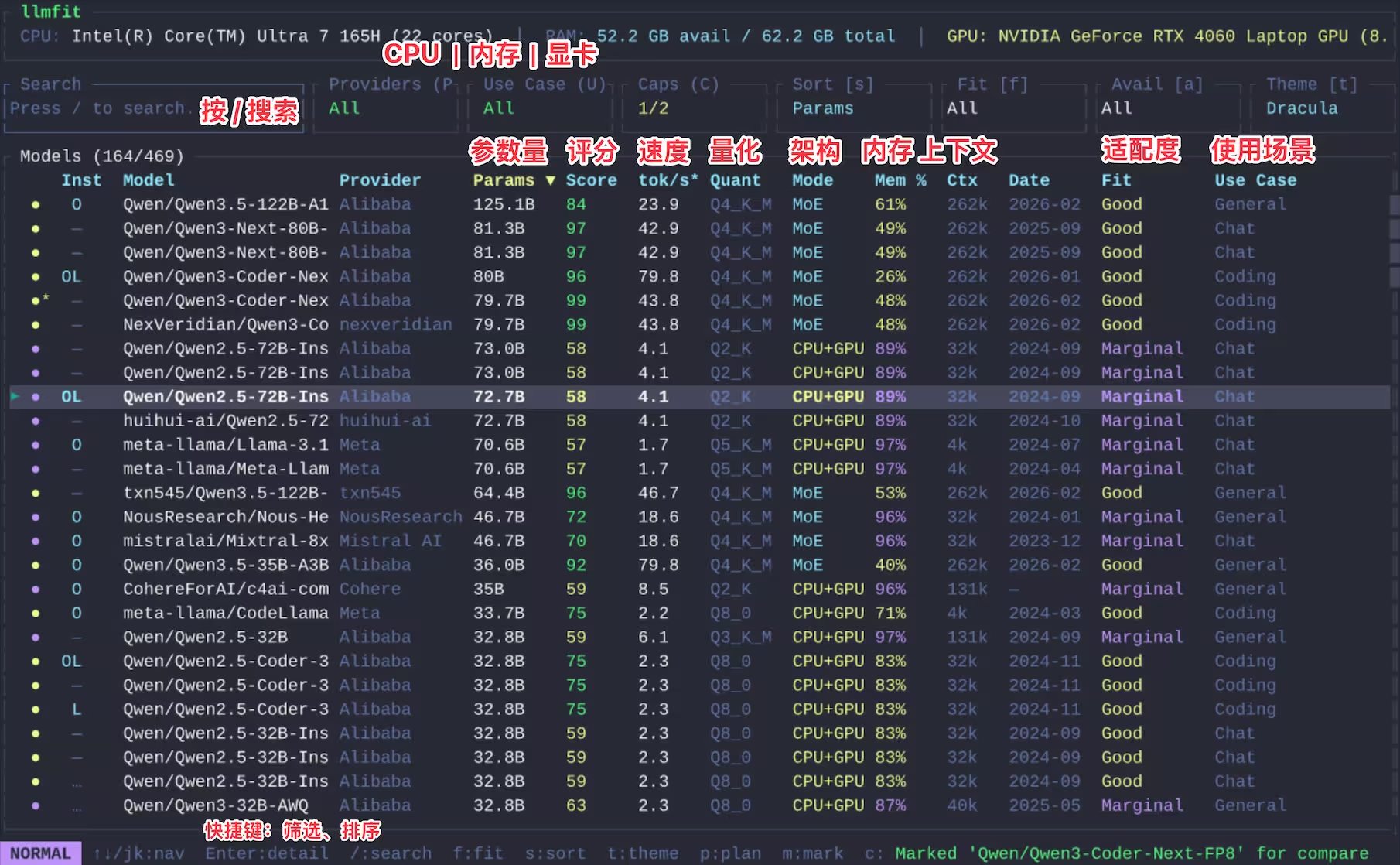

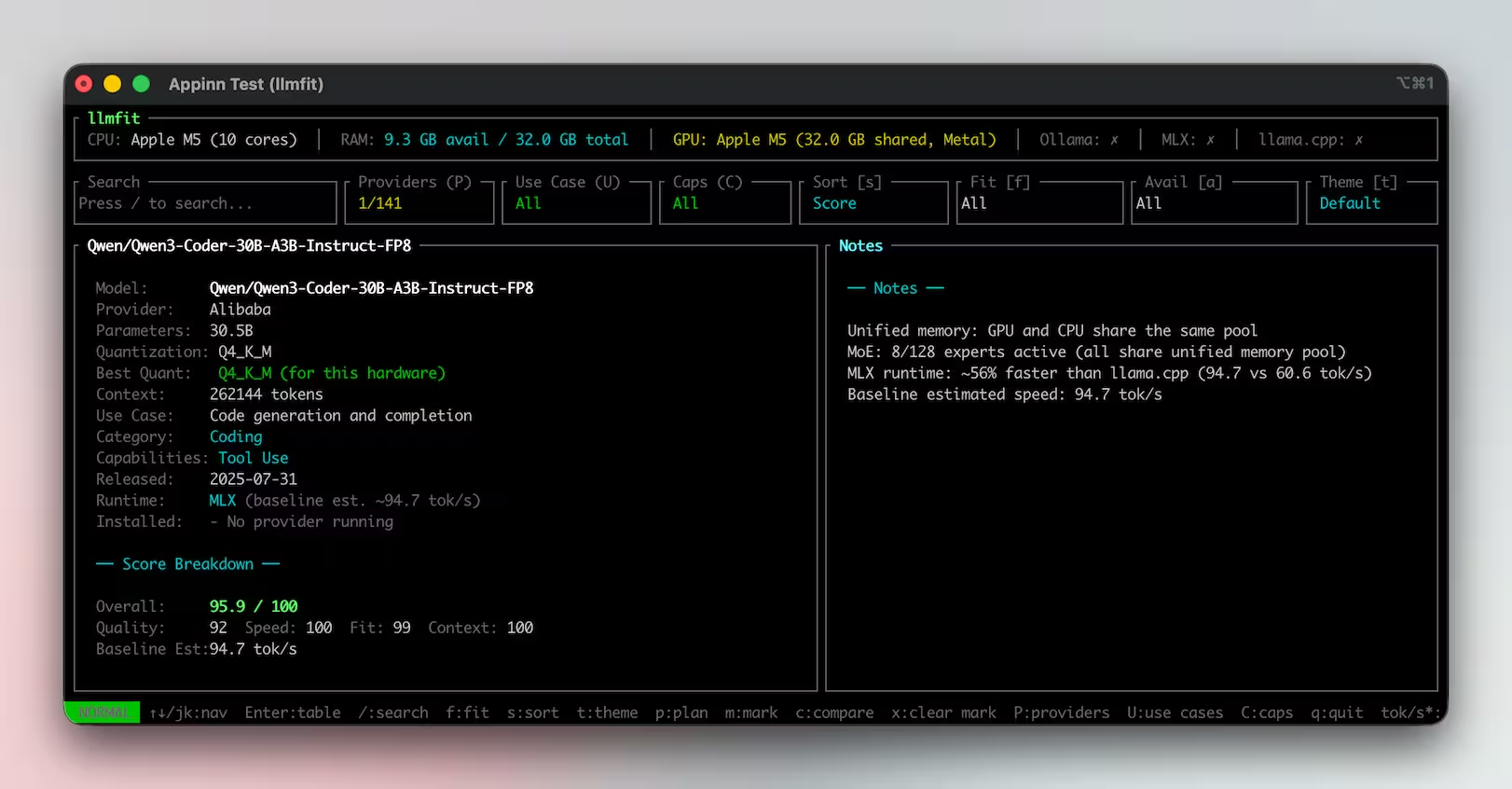

llmfit 是一款 TUI 程序(终端图形界面),它可以自动检测你的电脑 CPU、GPU、内存,从 500+ 款大模型中,列出当前硬件条件下能运行的大模型,并显示:

- 模型评分

- 推理速度(tok/s)

- 内存占用

- 上下文长度

- 模型用途

等等,一目了然。

运行后界面这样的,真的一秒出结果:

llmfit 会根据当前硬件配置,列出适合运行的模型列表,方便用户快速挑选。

一些使用技巧

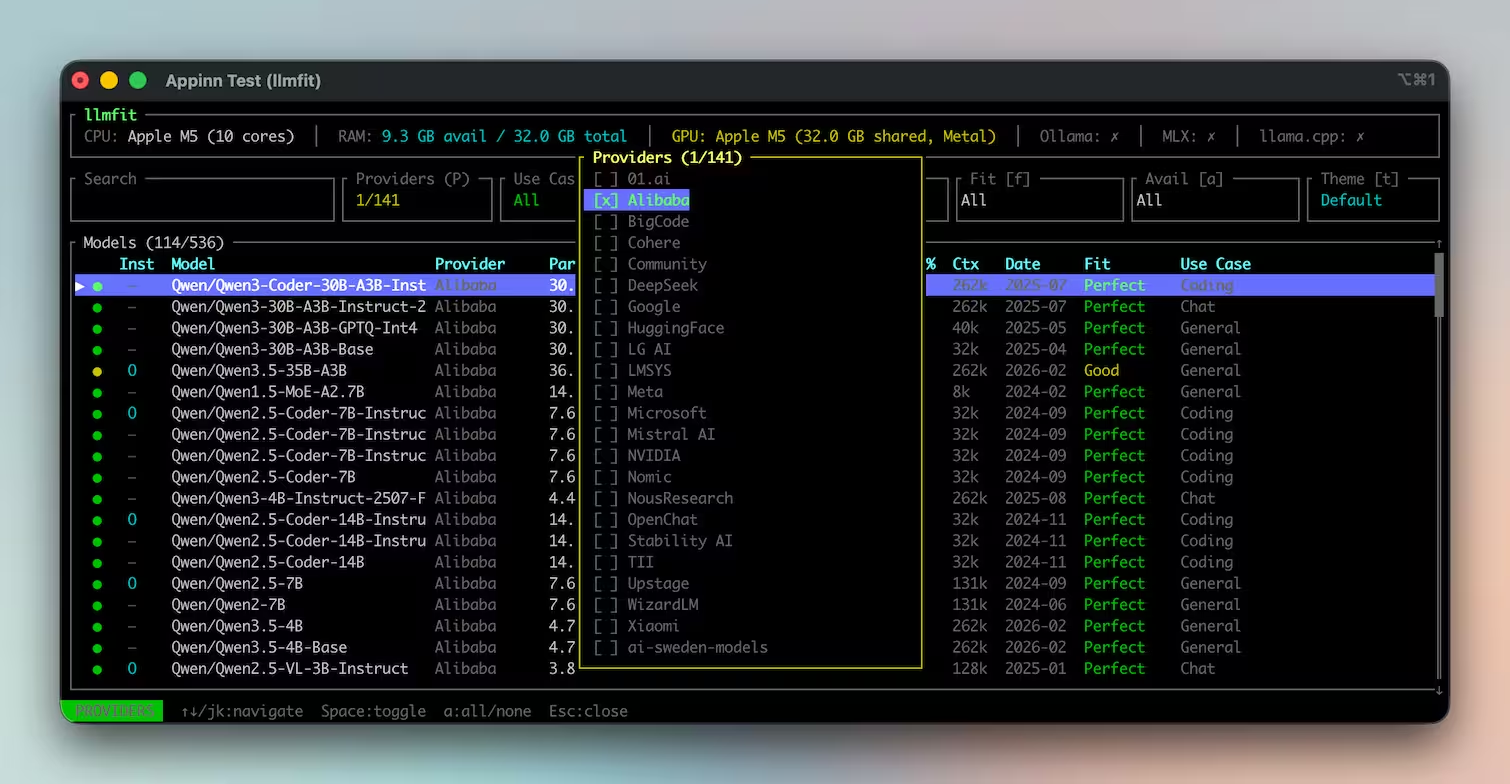

大模型数量非常多,llmfit 里能看到的有将近 500 款,我们可以通过快速筛选,来寻找模型。

比如:按下大些的 P,会出现提供商筛选,再按 a 取消全选,然后选择 Alibaba,就能快速筛选出 Qwen 模型:

接下来可以根据这些信息进一步选择:

- Ctx:上下文长度

- Score:模型综合评分

- Use Case:用途(聊天 / 编码 / 通用)

选中模型后,按 回车 查看详情:

例如,直接搜索模型名称:qwen/Qwen3-Coder-30B-A3B-Instruct-FP8

就可以找到模型对应的地址了,比如:https://huggingface.co/Qwen/Qwen3-Coder-30B-A3B-Instruct-FP8

用起来还是非常方便的。

获取

本地模型的优势

隐私

本地模型最大的优势,是隐私。你一定要知道:你输入到云端大模型里的任何内容,模型提供商都能够看到。

即使对方承诺:

- 不记录数据

- 不用来训练模型

但从技术上来说,它确实能拿到你输入的任何数据。

因此,如果涉及:

- 公司内部资料

- 代码

- 文档

- 私密内容

就只能选择本地模型。

成本

云大模型通常是:按 token 计费,或者按调用次数收费,使用频繁的话,费用会越来越高,比如 OpenClaw,消耗的 Token 数量十分惊人。

而本地模型:一次下载,长期使用。

运行成本只有:电费。

不限次数,不限调用。

不联网 & 无限制

还有一些实际体验上的优势:

- 离线可用:没有网络也能运行

- 内网可用:适合公司环境

- 没有使用限制:想怎么用就怎么用

如何部署本地模型

青小蛙觉得,如果是第一次部署模型,从 Ollama 开始,直接在客户端里下载模型就行了:

另外还能试试:

- Ollama

- LM Studio

- llama.cpp

基本上都能很方便地运行本地模型。

最后,希望你有足够的内存 😂

原文:https://www.appinn.com/llmfit/

如有侵权请联系:admin#unsafe.sh