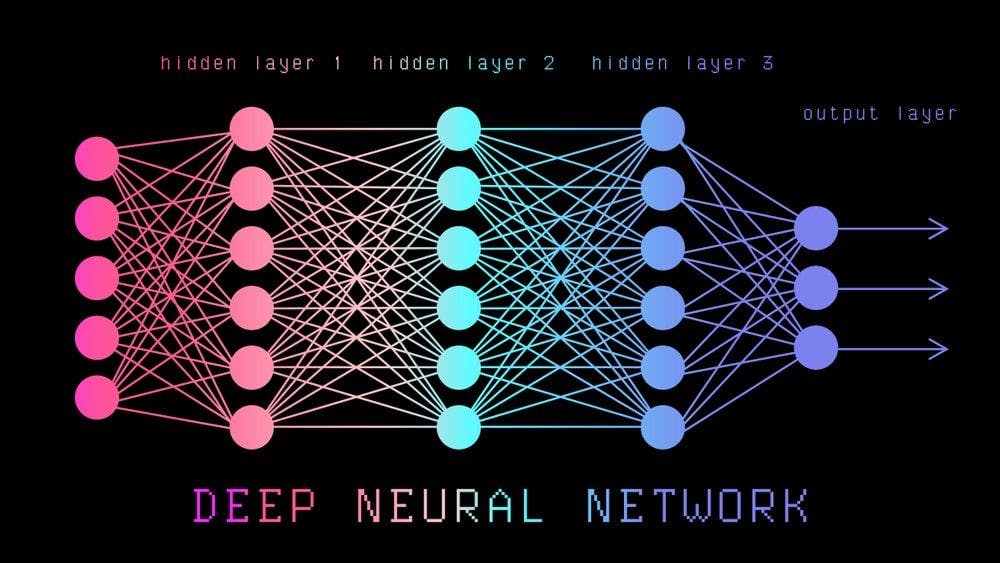

What Happens if You Remove ReLU From a Deep Neural Network?

好的,我现在需要帮用户总结一篇文章的内容,控制在100字以内,并且不需要特定的开头。首先,我得仔细阅读用户提供的文章内容。看起来这篇文章是关于深度学习和神经网络的,作者是Emmimal P Alexander,一个独立的人工智能研究员和作者。 文章中提到了一些关键词,比如ReLU函数、激活函数、PyTorch调试、MNIST实验等。这些都是深度学习中的重要概念和技术。我需要将这些内容浓缩成一个简洁的总结。 接下来,我要确保总结涵盖文章的主要观点:作者探讨了ReLU函数的作用,分析了激活函数对模型性能的影响,并通过MNIST实验展示了这些理论在实际中的应用。同时,文章还讨论了非线性在深度线性网络中的重要性。 最后,我要确保语言简洁明了,不超过100字,并且直接描述文章内容,不使用任何开头模板。这样用户就能快速了解文章的核心内容了。 </think> 这篇文章探讨了ReLU函数在深度神经网络中的作用及其对模型性能的影响,并通过MNIST实验展示了非线性激活函数的重要性。 2026-3-5 12:6:47 Author: hackernoon.com(查看原文) 阅读量:0 收藏

好的,我现在需要帮用户总结一篇文章的内容,控制在100字以内,并且不需要特定的开头。首先,我得仔细阅读用户提供的文章内容。看起来这篇文章是关于深度学习和神经网络的,作者是Emmimal P Alexander,一个独立的人工智能研究员和作者。 文章中提到了一些关键词,比如ReLU函数、激活函数、PyTorch调试、MNIST实验等。这些都是深度学习中的重要概念和技术。我需要将这些内容浓缩成一个简洁的总结。 接下来,我要确保总结涵盖文章的主要观点:作者探讨了ReLU函数的作用,分析了激活函数对模型性能的影响,并通过MNIST实验展示了这些理论在实际中的应用。同时,文章还讨论了非线性在深度线性网络中的重要性。 最后,我要确保语言简洁明了,不超过100字,并且直接描述文章内容,不使用任何开头模板。这样用户就能快速了解文章的核心内容了。 </think> 这篇文章探讨了ReLU函数在深度神经网络中的作用及其对模型性能的影响,并通过MNIST实验展示了非线性激活函数的重要性。 2026-3-5 12:6:47 Author: hackernoon.com(查看原文) 阅读量:0 收藏

New Story

by Independent AI researcher and author writing about deep learning and neural networks.![]()

March 5th, 2026

![]()

![]()

![]()

![]()

Audio Presented by

Speed

Voice

![]()

byEmmimal P Alexander@emmimalpalexander

![]()

Independent AI researcher and author writing about deep learning and neural networks.

Story's Credibility

![]()

![]()

Independent AI researcher and author writing about deep learning and neural networks.

Story's Credibility

About Author

Independent AI researcher and author writing about deep learning and neural networks.

Comments

TOPICS

Related Stories

文章来源: https://hackernoon.com/what-happens-if-you-remove-relu-from-a-deep-neural-network?source=rss

如有侵权请联系:admin#unsafe.sh

如有侵权请联系:admin#unsafe.sh