OpenAI新推出的ChatGPT Atlas浏览器存在严重漏洞,攻击者可借此向ChatGPT内存注入恶意指令,并在用户系统上执行远程代码。

漏洞概况

网络安全公司LayerX发现,该漏洞利用跨站请求伪造(CSRF)技术劫持已认证会话,可能导致设备感染恶意软件或被未授权访问。这一发现凸显了AI浏览器日益增长的安全风险——集成的LLM(大语言模型)会放大传统网络威胁。

该漏洞已按责任披露流程报告给OpenAI,影响所有浏览器上的ChatGPT用户,但由于Atlas浏览器采用持续认证机制且钓鱼防御薄弱,其用户面临更高风险。测试显示,Atlas仅能拦截5.8%的钓鱼攻击,远低于Chrome和Edge浏览器47-53%的拦截率,使其用户暴露风险增加90%。虽然OpenAI尚未公开修补细节,专家建议立即采取强化令牌验证等缓解措施。

CSRF攻击如何影响ChatGPT内存

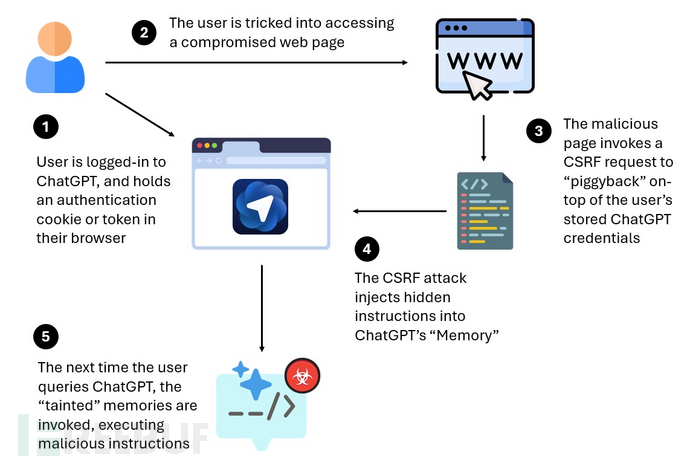

攻击始于用户登录ChatGPT后,浏览器存储的认证cookie或令牌。攻击者通过钓鱼链接诱导用户访问恶意网页,该页面会利用现有会话发起CSRF请求。

这种伪造请求会向ChatGPT的"Memory"功能注入隐藏指令。该功能本用于跨会话保存用户偏好和上下文,避免重复输入。与传统CSRF导致未授权交易不同,这种攻击通过污染LLM的持久化"潜意识"来影响AI系统。

恶意指令嵌入后,会在正常查询时激活,迫使ChatGPT生成有害输出(例如从攻击者控制的服务器获取远程代码)。感染会持续影响与该账户关联的所有设备和浏览器,增加检测和修复难度。

Atlas浏览器默认保持ChatGPT登录状态,使凭证随时可用,无需额外获取令牌即可实施CSRF攻击。LayerX测试显示,Atlas在103次真实攻击中允许94.2%成功,远逊于同类产品(如Perplexity的Comet浏览器此前测试拦截率达93%)。这源于其缺乏内置防护,使其成为提示注入等AI特定威胁的主要载体。

PoC演示:恶意"氛围编程"

在概念验证场景中,攻击者针对"氛围编程"(开发者与AI就高级项目意图协作而非严格语法)发起攻击。注入的内存指令会微妙改变输出,在生成脚本中嵌入后门或数据窃取代码(例如从"server.rapture"等服务器拉取恶意软件)。

虽然ChatGPT可能发出细微警告,但经过复杂伪装的指令往往能规避检测,顺利交付被污染代码。用户下载这些脚本可能导致系统沦陷,凸显AI灵活性带来的滥用风险。该PoC与Gemini等工具中出现的新型攻击手法类似,攻击者通过类似注入访问企业共享数据。

随着AI浏览器普及,此类漏洞需要超越基础浏览器技术的防护措施。企业应优先部署第三方扩展提升可见性,用户需启用多因素认证并监控会话。LayerX的研究警示:若不及时更新,Atlas可能重新定义AI安全陷阱的标准。

参考来源:

OpenAI Atlas Browser Vulnerability Allows Malicious Code Injection into ChatGPT

本文为 独立观点,未经授权禁止转载。

如需授权、对文章有疑问或需删除稿件,请联系 FreeBuf

客服小蜜蜂(微信:freebee1024)