read file error: read notes: is a directory 2025-10-3 13:31:27 Author: www.cybersecurity360.it(查看原文) 阅读量:8 收藏

Una recente indagine del Microsoft Threat Intelligence ha scoperto una campagna di phishing dove il codice malevolo era stato probabilmente offuscato grazie a un modello di linguaggio generativo.

Per Microsoft questo rappresenta un caso concreto di AI contro AI dove da una parte abbiamo l’AI che aiuta a mascherare il codice di un attacco, dall’altra l’AI difensiva che riesce a riconoscerne i tratti distintivi e a bloccarlo.

Secondo gli analisti di Microsoft, diversi fattori hanno indicato un’origine artificiale. Le funzioni e le variabili avevano nomi troppo descrittivi, il codice era strutturato in modo ordinato, i commenti erano generici e formali.

Tutti indizi che suggeriscono il contributo di un modello linguistico generativo, probabilmente impiegato dall’attaccante per scrivere e offuscare il codice.

In altre parole, la stessa AI che di solito viene usata per automatizzare compiti utili è stata impiegata per scopi criminali.

Un attacco che parte da un semplice allegato

La campagna individuata sfruttava l’account di posta elettronica compromesso di una piccola azienda.

L’e-mail veniva inviata dallo stesso indirizzo che compariva come destinatario, mentre i veri riceventi erano inseriti in copia nascosta. Un accorgimento particolare utile per sfuggire a certi controlli automatici.

Fonte: Microsoft.

Il messaggio di posta con tono apparentemente familiare e legittimo diceva che era stato condiviso un documento, un allegato che sembrava un PDF ma che in realtà era un file SVG (Scalable Vector Graphics), un formato grafico che può contenere codice attivo come JavaScript.

Questo dettaglio tecnico, apparentemente innocuo, è stato il cuore di tutto l’attacco.

“Ciò consente di distribuire payload di phishing interattivi che appaiono innocui sia agli utenti che a molti strumenti di sicurezza. Inoltre, i file SVG supportano funzionalità che favoriscono l’offuscamento, come elementi invisibili, attributi codificati ed esecuzione ritardata degli script, tutte utilizzabili per eludere l’analisi statica e il sandboxing.”, spiegano i ricercatori Microsoft.

Chi apriva l’allegato si trovava davanti ad una verifica CAPTCHA, che una volta superata reindirizzava la vittima verso una pagina di login fasulla, creata per rubare credenziali aziendali o personali.

Fonte: Microsoft.

Offuscamento del codice

Il file SVG conteneva diversi livelli di offuscamento. Apparentemente si trattava di un’immagine con grafici, etichette di mesi e altre decorazioni, ma molti di questi elementi erano resi invisibili tramite l’impostazione dell’opacità a zero e del riempimento in modalità trasparente allo scopo solo di rendere più difficile l’analisi da parte dei sistemi sicurezza.

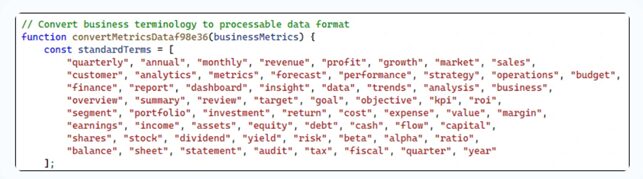

All’interno dello stesso file c’era poi un attributo insolitamente lungo, composto da una sequenza di parole di uso aziendale, termini come “revenue”, “operations”, “risk”, concatenate senza un vero senso apparente.

In realtà, quelle parole venivano ricombinate da uno codice JavaScript incorporato nel file SVG e decodificate per trasformarle in codice attivo.

“Invece di includere direttamente codice dannoso, gli aggressori hanno codificato il payload mappando coppie o sequenze di questi termini aziendali a caratteri o istruzioni specifici. Durante l’esecuzione, lo script decodifica la sequenza, ricostruendo la funzionalità nascosta da quelli che sembrano metadati aziendali innocui.”, continua il rapporto.

Fonte: Microsoft.

L’AI difensiva smaschera l’inganno

La parte interessante è che la tecnologia AI è stata decisiva anche nella difesa. Microsoft Security Copilot, la piattaforma di supporto basata su AI per gli analisti di sicurezza, ha riconosciuto nel file diversi tratti sintomatici di un contenuto generato da un LLM.

Quegli stessi particolari di scrittura artificiale che un criminale sperava servissero a offuscare, sono stati interpretati come segnali utili per classificare l’allegato come pericoloso.

Accanto all’analisi semantica del codice, hanno giocato un ruolo importante anche altri sistemi di protezione, come Microsoft Defender per Office 365.

Non si è trattato soltanto di leggere il contenuto del file, ma di osservare l’intero contesto: la tecnica di invio, l’uso dei Ccn, i domini coinvolti, i comportamenti sospetti del codice.

È questo approccio multilivello che ha permesso di neutralizzare l’attacco prima che potesse avere un impatto significativo.

Phishing: la battaglia si sposta su un piano nuovo

L’episodio, seppur contenuto, apre uno scenario più ampio. È sempre più probabile che campagne simili diventino frequenti: l’AI abbassa la barriera tecnica per chi vuole orchestrare un attacco e, allo stesso tempo, offre nuove opportunità di offuscamento.

Tuttavia, l’uso dell’intelligenza artificiale non rende questi attacchi invisibili. Al contrario, come dimostra il caso Microsoft, lascia spesso dietro di sé tracce sintetiche, artefatti linguistici o strutturali che possono essere riconosciuti dai sistemi difensivi.

Il messaggio chiave di questa vicenda è che il confronto tra attaccanti e difensori si è spostato su un piano nuovo, quello dell’intelligenza artificiale.

Non si tratta più solo di aggiornare antivirus o filtrare e-mail sospette, ma di saper leggere i segnali più sottili, quelli che distinguono il codice scritto da una macchina dal codice scritto da un umano.

L’AI, se usata con consapevolezza, non è soltanto un rischio è anche un alleato prezioso per difendere sistemi e dati in un mondo digitale dove gli attacchi diventano ogni giorno più sofisticati.

如有侵权请联系:admin#unsafe.sh